|

| credit: Scientific American |

E mi limito alla sola decodifica del mondo esterno basata sui "rilevatori" di forma, di movimento, (...), di colore (il cui deficit, acromatopsia, è cosa ben diversa dal daltonismo).

L'importanza di questi studi va oltre il mero interesse neurobiologico in quanto pone le basi per sistemi di riconoscimento automatico mutuati, come sempre avviene, dallo studio delle soluzioni adottate in natura.

Torniamo sullo stesso lavoro per vedere i progressi nel campo.

Il lavoro di mappaggio e decodifica (svolto in primis da Doris Tsao di Harvard ora alla UCLA) è partito dallo studio dei macachi in quanto dotati di un sistema visivo e di una organizzazione del cervello molto simile a quella umana.

|

| Doris Tsao (wikipedia) |

Lesioni in queste aree possono causare disturbi percettivi come la akinetopsia a causa della quale il paziente "non vede" l'oggetto in movimento ma solo un susseguirsi di "immagini" statiche.

La svolta nella ricerca si ebbe quando Doris Tsao, che era ancora uno studente di PhD nel team di Margaret Livingston ad Harvard, iniziò una collaborazione con Nancy Kanwisher del vicino MIT, che fornì la chiave di accesso ai meccanismi cerebrali grazie alla risonanza magnetica funzionale (fMRI). Grazie a questa tecnica non invasiva ed estremamente potente fu possibile identificare "visivamente" le aree del cervello umano che si illuminavano quando veniva mostrata l'immagine di un volto; aree inerti quando invece di un volto venivano mostrati oggetti di varia natura come una casa o un cucchiaio, a dimostrare che il riconoscimento "per sé" dell'oggetto è cosa diversa dalla elaborazione e decodifica dell'immagine di un volto.

Cosa ancora più interessante queste aree mostravano una certa specializzazione "visiva" nel senso che quando i ricercatori mostravano alle scimmie disegni di facce mancanti di qualche elemento (come il naso, le iridi, i capelli, ...) scoprirono di potere predire quali gruppi di neuroni erano coinvolti nel riconoscimento. All'inverso non solo si poteva predire quali elementi erano presenti dato il gruppo di neuroni attivati ma l'intensità dell'attivazione si correlava a quanto "estremo" fosse il dettaglio.

Ad esempio un neurone "specializzato" nella distanza tra gli occhi si attivava di più nel caso di occhi ravvicinati rispetto a volti con occhi più distanziati.

Nel dettaglio alcuni gruppi di cellule nella zona corticale esterna apparivano riconoscere volti orientati in un certo modo, mentre altre cellule più interne si attivavano quando venivano mostrate alle scimmie solo alcuni volti, qualunque fosse l'orientamento (ovviamente purché i volti fossero visibili).

Riassumendo il tutto, i ricercatori riuscirono a identificare 50 variabili nel volto (25 legate alla forma e 25 nell'aspetto) con i quali costruirono un set di 2 mila immagini di volti che differivano in un solo dettaglio. Mostrando ai macachi questi volti e registrando l'attivazione dei neuroni il codice sottostante cominciò a disvelarsi; in altre parole predire il volto monitorando quali neuroni si erano attivati divenne più di una ipotesi.

I risultati più recenti sembrano indicare che la "costruzione" dell'immagine di una persona parte dagli strati più esterni (dimensioni e poi dettagli specifici) fino ad arrivare agli strati più profondi in cui si può arrivare alla situazione che un neurone si attiva solo in presenza di un ben volto ben definito (che in associazione alle connessioni con la zona ippocampale porta al "riconoscimento").

Studi analoghi hanno identificato neuroni che sembrano rispondere alla "spigolosità" degli oggetti, al loro essere animati, etc etc.

Elementi questi che indicano quanto il processo di riconoscimento sia mediato da un processo di decodifica molto rapido di molti elementi che alla fine vengono "pesati e computati". Questo spiega anche perché a volte si possa confondere una persona con un'altra o magari impiegare qualche secondo per capire perché quel volto apparentemente non riconosciuto ci risulti familiare.

Il che ha senso evolutivamente per un genere come l'Homo in cui il riconoscimento olfattivo è residuale rispetto ad altri animali.Lo studio in esseri umani poneva ovvi limiti dettati dal doversi basare ad una analisi "esterna". L'unica speranza era che esistesse qualcosa di simile al riconoscimento facciale nelle scimmie in modo da potere testare con elettrodi ultrasottili quali fossero esattamente i neuroni coinvolti

Nota. Ricordo che il cervello è privo di recettori del dolore, in conseguenza gli elettrodi non solo non provocano disagio nell'animale ma non sono nemmeno percepiti. E questa non è una ipotesi ma un dato confermato da studi in umani.Gli 8 anni successivi all'inizio della collaborazione furono densi di soddisfazioni per i due team. Si scoprì ad esempio che i macachi erano in grado di riconoscere i volti, quindi mostrando loro una foto dietro l'altra di umani o di scimmie si riuscì ad identificare 6 piccole aree distribuite su ciascun lato del cervello nella corteccia IT (temporale inferiore) che apparivano interconnesse: se una veniva stimolata elettricamente anche le altre si "accendevano".

|

| Le aree coinvolte e la capacità di predire un volto "visto" in base alle cellule attivate (credit: S. Le Chang & D. Tsao via Nature) |

Cosa ancora più interessante queste aree mostravano una certa specializzazione "visiva" nel senso che quando i ricercatori mostravano alle scimmie disegni di facce mancanti di qualche elemento (come il naso, le iridi, i capelli, ...) scoprirono di potere predire quali gruppi di neuroni erano coinvolti nel riconoscimento. All'inverso non solo si poteva predire quali elementi erano presenti dato il gruppo di neuroni attivati ma l'intensità dell'attivazione si correlava a quanto "estremo" fosse il dettaglio.

|

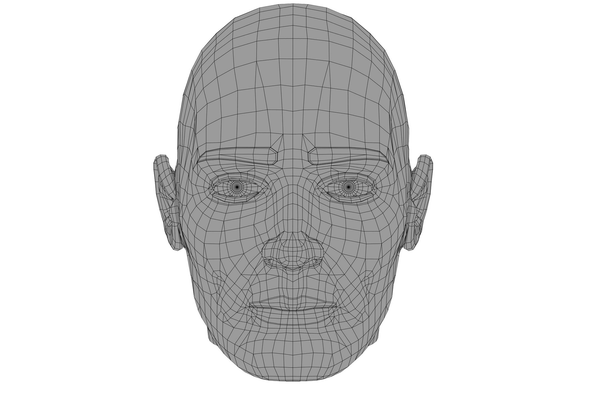

| Alcuni dei punti che il cervello "vede" e computa nel processo di scansione di un volto

(credit: S. Le Chang & D. Tsao via Nature) |

Ad esempio un neurone "specializzato" nella distanza tra gli occhi si attivava di più nel caso di occhi ravvicinati rispetto a volti con occhi più distanziati.

Nota. La scelta di usare disegni stilizzati di volti invece di fotografie nasceva dalla necessità di avere un completo controllo delle molteplici variabili che definiscono ciascun volto.Conclusioni confermate quando alle scimmie furono mostrate non solo foto di volti reali ma anche volti che guardavano in direzioni diverse (cosa che può apparire banale ma estremamente difficile da ottenere con programmi di riconoscimento facciale).

Nel dettaglio alcuni gruppi di cellule nella zona corticale esterna apparivano riconoscere volti orientati in un certo modo, mentre altre cellule più interne si attivavano quando venivano mostrate alle scimmie solo alcuni volti, qualunque fosse l'orientamento (ovviamente purché i volti fossero visibili).

Riassumendo il tutto, i ricercatori riuscirono a identificare 50 variabili nel volto (25 legate alla forma e 25 nell'aspetto) con i quali costruirono un set di 2 mila immagini di volti che differivano in un solo dettaglio. Mostrando ai macachi questi volti e registrando l'attivazione dei neuroni il codice sottostante cominciò a disvelarsi; in altre parole predire il volto monitorando quali neuroni si erano attivati divenne più di una ipotesi.

I risultati più recenti sembrano indicare che la "costruzione" dell'immagine di una persona parte dagli strati più esterni (dimensioni e poi dettagli specifici) fino ad arrivare agli strati più profondi in cui si può arrivare alla situazione che un neurone si attiva solo in presenza di un ben volto ben definito (che in associazione alle connessioni con la zona ippocampale porta al "riconoscimento").

Attenzione, questa è cosa ben diversa dal dire che un neurone identifica, per sé, una persona: il riconoscimento è mediato da una attivazione che coinvolge più neuroni che poi può "scaricarsi" su un numero molto ristretto di neuroni e solo da qui comparire la correlazione volto-neurone.Già nel 2005 Rodrigo Quian Quiroga aveva scoperto l'esistenza di neuroni che aveva ribattezzato "le cellule di Jennifer Aniston" sebbene sia ovvio che la natura non ci ha programmati per riconoscere la mitica Rachel di Friends. La scoperta venne durante lo studio di pazienti a cui erano stati impiantati elettrodi nel cervello per cercare di mappare le aree responsabili di attacchi epilettici refrattari ai trattamenti farmacologici. Si scoprì l'esistenza di segnali originati da singoli neuroni che comparivano solo quando al soggetto venivano mostrate foto di persone a lui note, non necessariamente suoi familiari. Non solo immagini del volto di Jennifer Aniston ma anche solo la lettura del suo nome o perfino il titolo di un film in cui lei aveva recitato provocavano l'attivazione di questi neuroni "concettuali", localizzati nell'ippocampo, un'area ben più profonda e antica della corteccia IT.

Studi analoghi hanno identificato neuroni che sembrano rispondere alla "spigolosità" degli oggetti, al loro essere animati, etc etc.

Elementi questi che indicano quanto il processo di riconoscimento sia mediato da un processo di decodifica molto rapido di molti elementi che alla fine vengono "pesati e computati". Questo spiega anche perché a volte si possa confondere una persona con un'altra o magari impiegare qualche secondo per capire perché quel volto apparentemente non riconosciuto ci risulti familiare.

Articolo successivo su tematiche correlate --> "Testare la visione cromatica nei pesci"

Fonti

- How the brain’s face code might unlock the mysteries of perception

Nature /news (12/2018)

- Primates Use Simple Code to Recognize Faces

The Scientist (06/2017)

- The Code for Facial Identity in the Primate Brain

LeChang & Doris Y. Tsao, (2017), Cell, 169(6) pp1013-1028

Nessun commento:

Posta un commento